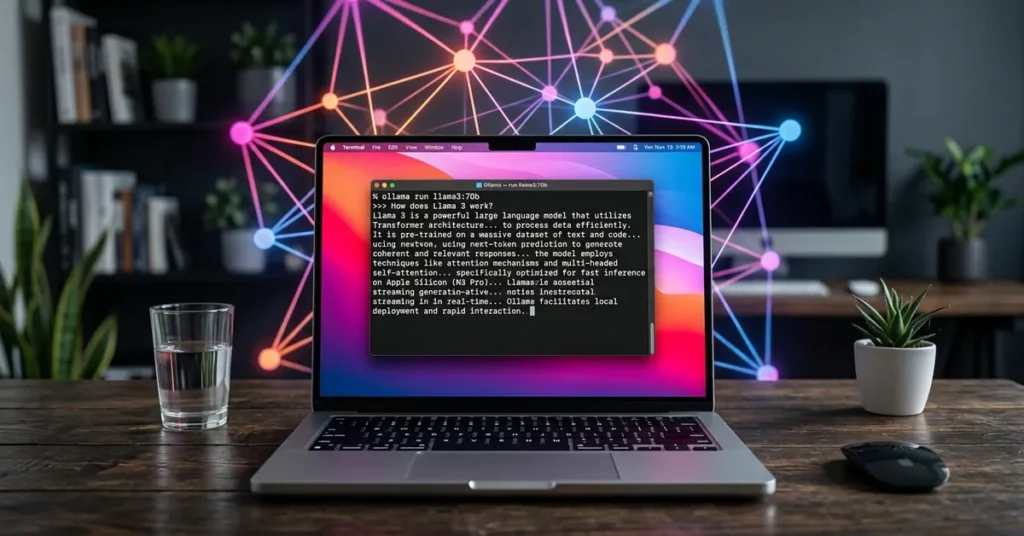

Ollama على Apple Silicon أصبح أسرع من أي وقت مضى مع إطلاق النسخة التجريبية من Ollama 0.19، التي تعتمد على إطار عمل MLX من Apple لتحقيق قفزة نوعية في أداء نماذج الذكاء الاصطناعي المحلية على أجهزة macOS. يستفيد التحديث الجديد من بنية الذاكرة الموحدة في شرائح Apple Silicon لتقديم سرعات استدلال لم يسبق لها مثيل.

ما هو Ollama على Apple Silicon ولماذا يهمك؟

في الإصدارات السابقة، كان Ollama يعتمد على خلفية مختلفة لتشغيل النماذج على macOS. مع الإصدار 0.19، أُعيد بناء المنصة بالكامل فوق إطار عمل MLX المفتوح المصدر من Apple، المصمم خصيصاً لشرائح Apple Silicon. النتيجة هي تحسن ملحوظ في الأداء عبر جميع أجهزة Apple Silicon، من M1 وصولاً إلى أحدث شرائح M5. بالنسبة للمطورين الذين يشغّلون نماذج الذكاء الاصطناعي محلياً، هذا التحديث يغير قواعد اللعبة.

أرقام الأداء: سرعة المعالجة والتوليد

الأرقام تتحدث عن نفسها. اختبارات أُجريت في 29 مارس 2026 باستخدام نموذج Qwen3.5-35B-A3B من Alibaba على شريحة M5 أظهرت النتائج التالية:

- سرعة المعالجة المسبقة (Prefill): 1,810 رمز/ثانية مع Ollama 0.19 مقابل 1,154 مع Ollama 0.18 — تحسن بنسبة 57%

- سرعة التوليد (Decode): 112 رمز/ثانية مع Ollama 0.19 مقابل 58 مع Ollama 0.18 — ضعف السرعة تقريباً

- مع ضغط int4: يصل Ollama 0.19 إلى 1,851 رمز/ثانية معالجة و134 رمز/ثانية توليداً

على شرائح M5 وM5 Pro وM5 Max تحديداً، يستفيد Ollama الآن من مسرّعات GPU Neural الجديدة لتقليل وقت الاستجابة الأولى وزيادة سرعة التوليد. هذا يجعل أجهزة Mac منافساً حقيقياً لمهام الاستدلال المحلي المتطلبة.

دعم NVFP4 والتخزين المؤقت الذكي

يُقدّم Ollama 0.19 أيضاً دعم تنسيق NVFP4 من NVIDIA، الذي يحافظ على دقة النموذج مع تقليل متطلبات النطاق الترددي للذاكرة والتخزين. يُقرّب هذا مستخدمي Ollama من نتائج بيئات الإنتاج السحابية، مما يعني توافقاً أكبر بين التجربة المحلية والنشر الفعلي. كما خضع نظام التخزين المؤقت لتحسينات جوهرية تخدم تطبيقات الذكاء الاصطناعي ووكلاء البرمجة:

- استهلاك ذاكرة أقل: إعادة استخدام الذاكرة المؤقتة عبر المحادثات لتقليل الضغط على الذاكرة عند استخدام أدوات مثل Claude Code

- نقاط تفتيش ذكية: تخزين لقطات في مواقع استراتيجية من الطلب لتسريع الاستجابات وتقليل المعالجة المكررة

- إخلاء أذكى للذاكرة: البادئات المشتركة تبقى أطول حتى عند حذف الفروع القديمة

كيف تبدأ مع Ollama 0.19

هذا الإصدار التجريبي مُحسَّن لنموذج Qwen3.5-35B-A3B مع معاملات ضبط مخصصة لمهام البرمجة والتعلم. يشترط امتلاك جهاز Mac بذاكرة موحدة تتجاوز 32 جيجابايت. يمكن البدء بالأوامر التالية:

- Claude Code:

ollama launch claude --model qwen3.5:35b-a3b-coding-nvfp4 - OpenClaw:

ollama launch openclaw --model qwen3.5:35b-a3b-coding-nvfp4 - محادثة مباشرة:

ollama run qwen3.5:35b-a3b-coding-nvfp4

أعرب فريق Ollama عن امتنانه لفريق مساهمي MLX، ومساهمي NVIDIA في ضغط NVFP4 ودعم MLX CUDA، ومجتمع GGML وllama.cpp، وفريق Alibaba Qwen على نماذجهم مفتوحة المصدر. تشمل التحديثات المستقبلية توسيع قائمة البنى المدعومة وتسهيل استيراد النماذج المخصصة. يمكن الاطلاع على التفاصيل الكاملة على المدونة الرسمية لـ Ollama.